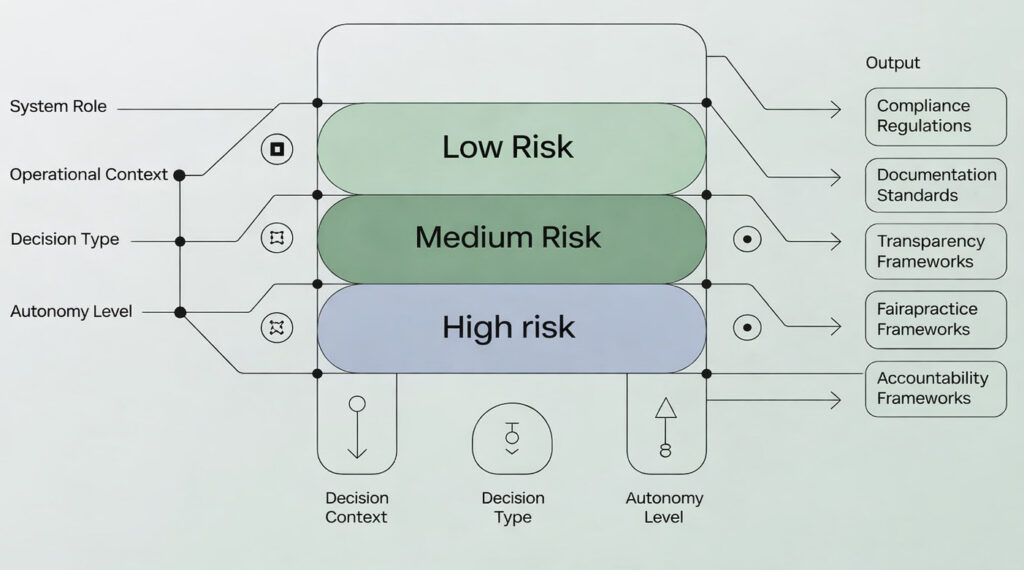

L’EU AI Act introduce obblighi differenziati in base alla classificazione di rischio dei sistemi AI. Per le organizzazioni che adottano un DORG, la classificazione non è scontata: dipende dal ruolo assegnato al dipendente digitale, dal contesto operativo, dalla tipologia di decisioni in cui è coinvolto e dall’autonomia concessa. Un DORG che supporta decisioni finanziarie in ambito creditizio ha un profilo di rischio radicalmente diverso da uno che gestisce la comunicazione interna.

Questa competenza fornisce il framework interpretativo elaborato da DORG Society per applicare l’EU AI Act all’ecosistema dei dipendenti digitali: come classificare il rischio del proprio DORG in base al ruolo assegnato, quali obblighi ne derivano per l’organizzazione, come strutturare la documentazione di conformità, come il sistema di supervisione umana e la telemetria DORG rispondono ai requisiti di trasparenza e tracciabilità previsti dalla normativa.

Contenuti principali: classificazione del rischio AI Act applicata ai DORG, obblighi per sistemi a rischio limitato e alto rischio, requisiti di documentazione e trasparenza, ruolo del Human Oversight Supervisor nella conformità normativa, raccordo tra Code of Conduct DORG e requisiti EU AI Act, aggiornamenti normativi e impatto sull’ecosistema.